Etichettato: intelligenza artificiale

Cartolina. Intelligenza naturale

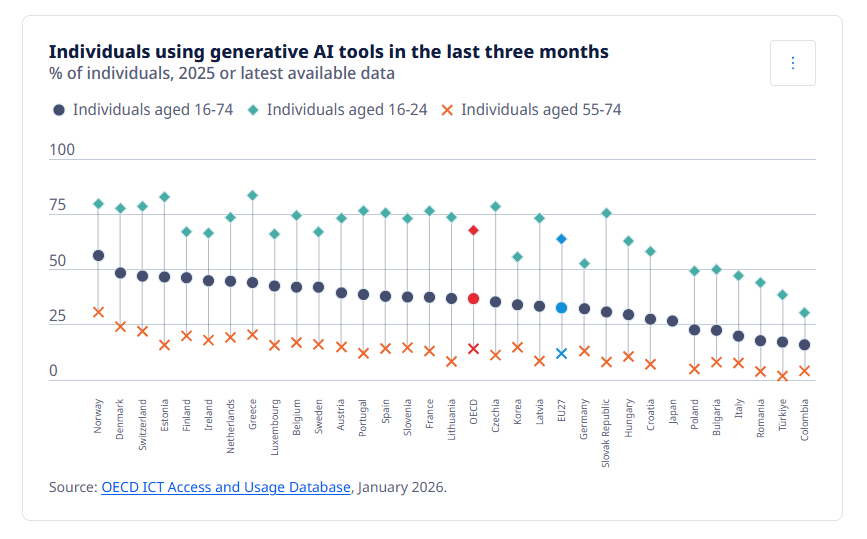

Negli ultimi tre mesi, solo il 7,7 per cento degli italiani fra i 55 e i 74 anni, che poi sono la categoria per le quali cresce di più l’occupazione, ha fatto uso di strumenti di intelligenza artificiale. I 16-74enni sono stati invece il 17,8 per cento, poco più del doppio. I più giovani, i 16-24enni, che si presume siano più sensibili all’oggetto sono stati solo il 47,2 per cento. In pratica meno attratti di noi dalle meraviglie dell’IA sono solo rumeni, turchi e colombiani. C’entra l’età, sicuramente, visto che mediamente i più anziani sono meno attratti dalle novità tecnologiche. Ma c’entra anche il livello di alfabetizzazione, che incidentalmente ha a che fare con il lavoro che uno fa. Un paese pieno di anziani e dove il livello medio dei titoli di studio è ancora basso rispetto a paesi simili al nostro si candida naturalmente a un minor utilizzo delle tecnologia all’avanguardia come l’intelligenza artificiale. A meno che, certo, non abbia una elevata considerazione della sua intelligenza naturale. Sarà sicuramente il nostro caso.

Cartolina. Disintelligenza naturale

Il problema non è l’intelligenza artificiale, che ormai galoppa senza freni, ma la disintelligenza naturale, ossia la nostra attitudine a lasciar fare alla macchina quello che potremmo fare con poco sforzo e molto piacere, perché prevale il pensiero che lo sforzo non vale comunque il piacere. L’incredibile crescita della tecnologia di chat gpt, che in un anno ha raggiunto una quota di famiglie americane pari a quella raggiunta dagli smartphone dopo quattro, è il segnale della nostra crescente ritrosia a pensare, a cercare, a scoprire. Perciò lasciamo queste attività, fonti primarie di sviluppo di tutto ciò di buono che abita in noi, la svolgano le macchine, essiccando l’origine naturale di molte gioie. E poiché il cervello è plastico, e ha ottima memoria, taglia i rami secchi e si adegua. L’intelligenza artificiale surroga quella naturale, ormai divenuta disintelligenza: semplice ossequio a quanto deciso dall’algoritmo. Lasciamo che la macchina decida la nostra agenda, l’itinerario delle nostre vacanze, il nostro menù. Smettiamo di affaticarci con le decisioni, convinti che così saremo più felici. Mentre saremo semplicemente più ubbidienti. Forse, nel profondo, pensiamo che sia la stessa cosa.

L’intelligenza artificiale delle banche centrali

Ai tanti curiosi che si interrogano sul futuro dell’intelligenza artificiale potrebbe essere utile dare un’occhiata al presente, magari prendendo a prestito dalle esperienze che con un certo successo, almeno a quanto racconta la Bis nel suo ultimo Bollettino, ne hanno fatto le banche centrali per affrontare alcuni dei loro sofisticati compiti, che vanno dall’analisi macroeconomica alla supervisione dei sistemi di pagamento.

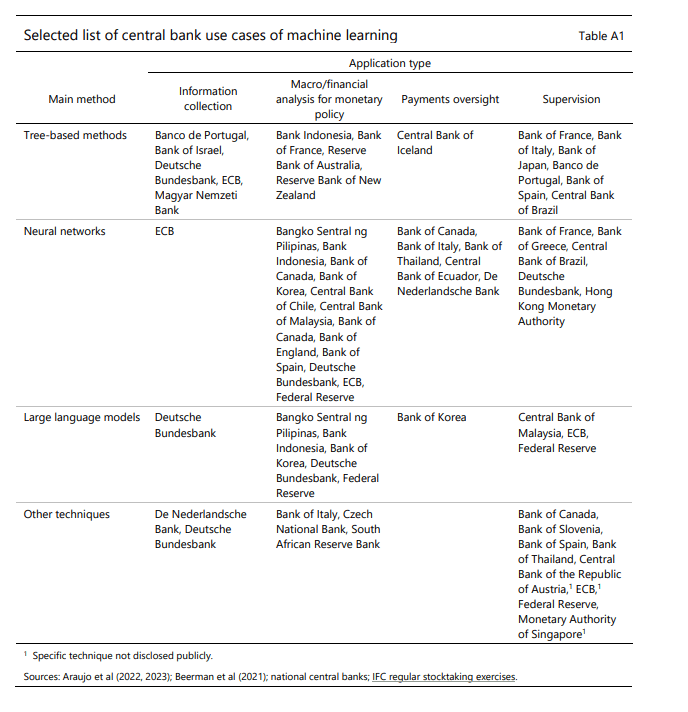

Il Bollettino illustra alcuni dei metodi più comuni utilizzati dagli istituti, che partono dalla tecnologia di machine learning, una sorta di algoritmo che evolve i classici modelli statistici predittivi, che ormai è diventata molto sofisticata. Gli algoritmi originano degli alberi decisionali – Decision Tree – che consentono un utilizzo più analitico dei dati. Ad esempio se ci parla di abitazioni, si può distinguere a seconda del numero di vani o dalla data di costruzione, e assegnare ad ogni partizione una diversa routine. Insomma: si può calcolare sempre più finemente.

Un’altra tecnica è quella della Random forests, che utilizza i dati degli alberi decisionali in maniera ancora più flessibile. Ma probabilmente la tecnologia più sofistica è quella delle reti neurali, che si basa su neuroni artificiali che simulano quelli umani. Ogni livello elabora un input e lo trasforma in output che viene comunicato al livello successivo, come il segnale elettrico che un neurone “passa” a quello vicino. E’ la tecnologia alla base del riconoscimento facciale degli smartphone o degli assistenti vocali.

Questa tecnologia ha avuto uno sviluppo notevole con l’introduzione, nel 2017, dei cosiddetti Transformers che hanno fatto evolvere le reti neurali in strumenti di processo del linguaggio (natural language processing, NPL; Large language models, LLMs) che in pratica implementano una sorta di intelligenza contestuale che si attiva con l’analisi delle relazioni fra le diverse variabili processate. In sostanza sono alla base della cosiddetta Generative AI, quella di Chat Gpt, per essere chiari.

Di questo arsenale molte banche centrali hanno fatto notevole uso (grafico sopra) avendo ben chiaro che alle opportunità si accompagnano diverse sfide. Un esempio chiarirà: “I modelli sofisticati di machine learning possono diventare quasi perfetti nella previsione. Ma poiché molte variabili interagiscono in modi complessi e non lineari, può essere difficile interpretare l’importanza dei diversi input per il risultato. Una buona previsione può quindi avvenire a costo di accettare che il modello sottostante sia una “scatola nera”.

In sostanza, c’è il rischio di fidarsi troppo, e quindi non comprendere davvero il responso dell’oracolo. Inoltre, esiste un vero e proprio “hallucination problem”, al quale sono soggetti gli algoritmi, che rende necessaria la supervisione delle persone per non adottare scelte sbagliate. Questo certo non evita che si commettano errori. Le macchine non ci evitano scivoloni. Si sbaglia sempre, come ai vecchi tempi. Ma adesso lo facciamo in buona compagnia.

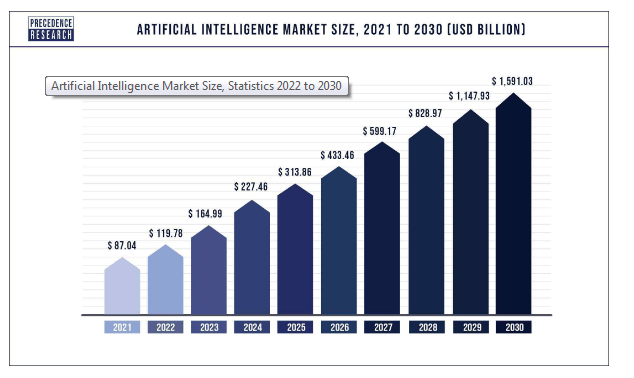

Cartolina. Investimenti artificiali

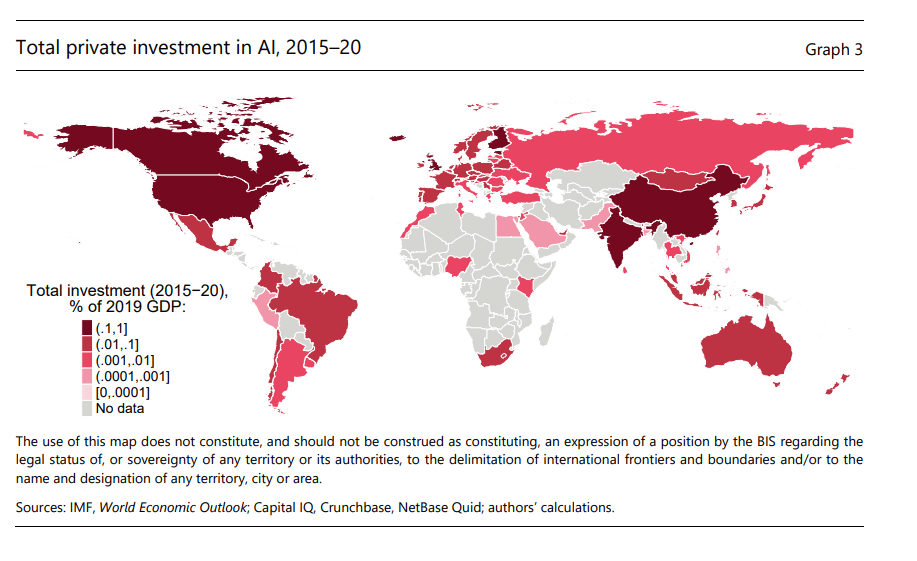

Nel quasi decennio trascorso dal 2015, solo Nordamerica, Cina e India sono arrivati a investire l’1 per cento del loro pil per sviluppare l’intelligenza artificiale. Il che ci comunica con ragionevole certezza che sarà da queste regioni che si svilupperà l’ondata robotica del pensiero che finirà col sommergerci. Saremo ovviamente ben felici di scambiare la nostra stupidità naturale con l’intelligenza artificiale, salvo scoprire poi, quando magari sarà troppo tardi, che quella artificiale non era poi così intelligente, e che neanche eravamo noi così stupidi. Ma avremo sviluppato sicuri rimedi contro la nostalgia. L’avremo scambiata con una notifica.

Le conseguenze economiche dell’IA generativa

Considerate quel che segue come un semplice assaggio di ciò che sarà, mano a mano che l’IA svolgerà i suoi effetti. Perché il punto saliente, in un mondo che ama il profitto almeno quanto dice il contrario, è capire se le aziende troveranno una loro convenienza ad utilizzare le varie Chat Gpt che sorgeranno da qui all’eternità.

Perciò diamo il benvenuto a uno studio recente pubblicato da NBER che già dal titolo – Generative AI and firm values – ci dice quel che dobbiamo sapere, e ricordare, di questa tecnologia. Ossia che avrà un futuro in misura diretta dei profitti che saprà produrre, essendo in fondo la creazione di valore l’unica cosa che davvero si chiede di generare all’intelligenza artificiale, visto che a quanto pare quella umana non basta più.

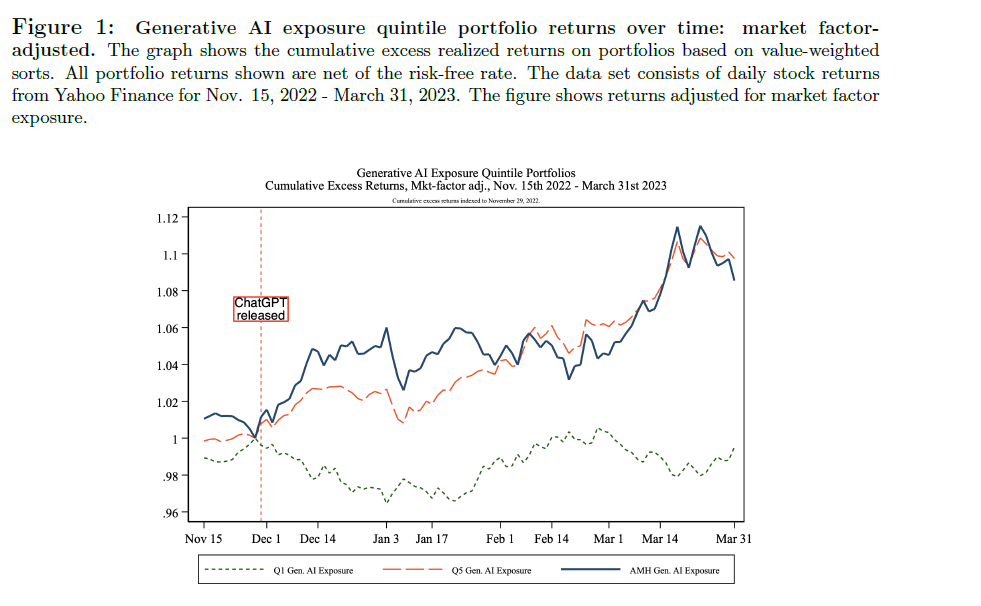

Ed ecco l’esercizio, perciò, che in quanto tale va considerato nulla di più di quel che è: un pacchetto di dati costruito sulla base di alcune ipotesi. In particolare, ci si propone di osservare la valutazione delle aziende, misurata attraverso gli indici di borsa, utilizzando come discriminante il diverso livello di esposizione all’uso di Chat Gpt, a partire dal momento in cui la tecnologia è stata rilasciata e nell’arco di un certo periodo di tempo.

Inutile stare a sottolineare la fragilità di questa costruzione. Come dicevo in apertura, è solo l’inizio dello show e peraltro chiunque frequenti la modellistica internazionale sa bene quanto siano esili le base epistemologiche di queste costruzioni intellettuali che finiscono tuttavia per diventare così influenti.

Fatte salve le premesse, arriviamo alle conclusioni. Ecco la prima che dobbiamo tenere a mente: “La scoperta chiave è che l’arrivo di ChatGPT ha avuto un considerevole effetto positivo sul valore delle imprese la cui forza lavoro è maggiormente esposta all’IA generativa e ai relativi modelli di linguaggio esteso”. Chi l’avrebbe mai detto.

Farà sicuramente piacere alle aziende editoriali, per dirne alcune. Le compagnie con un alto livello di esposizione della loro forza lavoro ad essere maggiormente produttive con l’uso di IA hanno sovra-performato di 40 punti base quelle con minore esposizione. Ma non solo nei loro confronti: anche rispetto a quelle con esposizione neutra.

I canali tramite i quali arrivano questi aumenti di valore sono due. Il primo è un puro flusso di cassa: meno persone, che costano di più, e più IA, che costa meno, uguale più soldi in pancia. Il secondo è un flusso di cassa “indiretto”. Il vantaggio del miglioramento tecnologico si trasferisce a tutta l’azienda, rendendola più profittevole.

Interessante osservare anche l’evento contrario, ossia che per alcune tipologie di aziende l’introduzione di IA generativa non ha sortito effetti positivi. Ad esempio per le aziende già sul mercato con una posizione “robusta”, I cosiddetti incumbent. Costoro, che hanno sicuramente fastidiose pastoie di vario genere, molto facilmente possono essere spiazzate da aziende di nuova formazione che sono native IA. Ma una volta consolidate, le prime diventano difficilmente insidiabili.

Leggendo il testo si possono scoprire altre informazioni interessanti. Ad esempio che “le occupazioni più colpite sono quelle che comportano attività con compiti cognitivi non di routine. Ciò è in netto contrasto con le scoperte precedenti secondo le quali l’automazione sostituisce principalmente occupazioni che comportano compiti di routine”.

Neanche troppo sorprendente, a ben pensarci. Più l’artificio diventa intelligente, più diventano oggetto di artificio i compiti che richiedono maggiore intelligenza. Anche scrivere un articolo può diventare una routine: dipende da come si intende questa parola e come si costruiscono i contenuti dell’articolo. E soprattutto le sue finalità. Nessuno stupore, quindi, che le attività manuali siano meno interessate a Chat Gpt: quelle che potevano essere automatizzate già lo sono state negli ultimi due secoli.

Al netto di certe ingenuità, frutto dello scarso senso storico di molti economisti, rimane il punto saliente. Questa tecnologia è un altro passo in avanti nella lunga strada umana verso l’automazione. Un sogno antico. La storia ci racconta, fra i tanti esempi possibili, del sogno degli inventori settecenteschi, alla ricerca del nuovo Adamo biblico purgato dal peccato originale, di costruire l’automa immortale che avrebbe sostituito l’uomo. E, soprattutto, ci dice che questo processo non solo è profittevole, ma anche inarrestabile, almeno fino a quando esiste energia sufficiente ad alimentare le macchine.

Questo è il succo del discorso. Che poi questa automazione si consumi nel solito ciclo distruzione-creazione, reso celebre da Schumpeter non dovrebbe sorprenderci più di tanto. Dobbiamo solo capire come gestire questa novità e ridisegnare molti modelli di comportamento.

Per farlo dobbiamo ricordare solo una semplice evidenza, che nel dibattito rimane sempre celata da montagne di paure millenaristiche: l’IA siamo noi. Se pensiamo davvero che l’IA diventerà qualcos’altro, rispetto a noi, non stiamo progettando una macchina. Ma covando l’ennesimo incubo. Il problema è che se lo facciamo tutti insieme, questo incubo può diventare reale.

Se vi piace quello che pubblica questo blog e volete sostenerlo, potete farlo comprando la Storia della ricchezza, il mio libro edito da Diarkos (tutte le info a questo link) che molto deve a questo lungo percorso che abbiamo iniziato oltre dieci anni fa. Lo trovate in tutte le librerie e anche on line. Su Amazon sta già scalando le classifiche della sua categoria. Aiutatelo a crescere. E buona lettura.

Cartolina. I chatbot siamo noi

Abbiamo paura delle macchine da quando abbiamo iniziato a costruirne. Temiamo l’innovazione, e tuttavia non riusciamo a farne a meno. Almeno da quando siamo diventati capaci di creare tecnologie. Vale per la ruota, il fuoco – pensate a quanto doveva spaventarci il fuoco, ci fa paura ancora oggi – , i telai meccanici e oggi l’intelligenza artificiale. Siamo scimmie vestite che hanno paura di ciò che indossano, perché temono di trasformarsi nel vestito. Lo spauracchio verso l’IA è solo la versione riveduta a corretta di quello che all’inizio del XIX si chiamava luddismo, e il fatto che gli ultra-miliardari firmino manifesti per invitare alla prudenza contro le macchine cosiddette intelligenti non è diverso da quando i Tudor inglesi vietavano le macchine per stampare fibbie. La paura è un sentimento democratico e trasversale. Esattamente come il coraggio. Il punto però non qui temere le macchine perché ci rubano il lavoro. Ciò che è davvero importante è capire che se abbiamo paura che un computer, che non fa altro che rimescolare idee e fatti noti, scriva meglio di noi un testo, una poesia, una musica o quello che volete voi, significa che abbiamo paura di non aver più nient’altro da dire. Nulla da aggiungere a ciò che è stato scritto, suonato, dipinto e, in sostanza immaginato. Ma in questo caso i bot saremmo noi. E’ di questo che abbiamo paura.

La rivoluzione finanziaria dei robot “intelligenti”

Procede silente, eppure inesorabile, la rivoluzione dell’intelligenza artificiale che ormai interessa aree sempre più estese della nostra società. Ai molti timori di pochi, anche se illustri, fanno eco le tante pratiche più o meno conosciute che lentamente iniziano a pervadere ogni ambito delle nostre attività e che ovviamente non potevano risparmiare il settore finanziario, che sullo straordinario sviluppo tecnologico ha costruito le sue tante fortune nell’ultimo ventennio. Fortune altalenanti, certo, ma che comunque si fondano sempre più sulla gestione di quantità crescenti di dati trasmessi ed elaborati a grande velocità lungo tutto il pianeta. Ogni tanto questa attività silente, che si svolge lungo cavi interrati negli oceani e in asettiche e sorvegliatissime data room, si manifesta in eruzioni sorprendenti, che le cronache finanziarie descrivono come flash event, o flash crash. Situazioni che si esauriscono nello spazio di millesimi di secondo durante i quali questo o quel titolo, o quella valuta, subiscono andamenti che l’intelligenza umana non è in grado di comprendere e che riesce a rilevare solo perché l’occhio dei calcolatori che misurano la temperatura delle borse è sempre aperto e registra ogni cosa. Possiamo vedere questi eventi perché le stesse macchine che li provocano ne sono testimoni.

Il resto dell’articolo è disponibile su Crusoe, una newsletter che si può leggere solo abbonandosi. Tutte le informazioni le trovi qui.

L’economia dell’Intelligenza artificiale

La prima macchina intelligente sarà anche l’ultima macchina creata dall’uomo, scrisse qualcuno tanti anni fa, evocando timori millenaristici che poi tanta fiction ha reso popolari. E tuttavia ciò non ha avuto il minimo effetto dissuasivo sulla ricerca del nostro moderno sacro graal: l’intelligenza artificiale. Moderno, poi, per modo di dire, estrinsecandosi la modernità in null’altro che nei mezzi tramite i quali questa ricerca viene condotta. Ma se guardiamo ai fini, agli esiti che si propone di raggiungere, il robot intelligente del XXI secolo non è poi così diverso dall’homunculus degli alchimisti: rappresenta la sfida dell’uomo alla natura, o a Dio per chi ci crede, nella forma della creazione di un essere intelligente che sia servo dell’uomo al fine di liberarlo da ciò che non vuole più fare. E poi cosa farà quest’uomo finalmente libero?

Questa domanda sembra relegata al piano inferiore delle questioni sociali. Salvo quando si ricorda che un uomo improvvisamente non più schiavo di dover fare un lavoro sgradevole, perché al suo posto ci sarà una macchina, dovrà comunque avere un reddito da consumare, perché sennò nessuno pagherà l’energia per la macchina che produce per lui. Ed è qui che l’economia fa capolino. Ma se guardiamo meglio, tutto il mito dell’intelligenza artificiale è permeato dall’economia. “L’intelligenza artificiale (AI, ndr) dovrebbe essere benvenuta per i suoi benefici economici potenziali,”, recita un rapporto presentato dalla Casa Bianca nel dicembre scorso (“Artificial intelligence, automation and the economy”).

Il resto dell’articolo è disponibile su Crusoe. Per leggerlo è necessario abbonarsi. Tutte le informazioni le trovi qui.

Uber, i tassisti e l’auto che si guida da sola

La cronaca ci riporta di nuovo delle agitazioni dei tassisti per vicende politiche legate a Uber, la piattaforma di sharing che i conducenti delle auto pubbliche hanno eletto a nemico pubblico numero uno. Su questa vicenda le opinioni sono le più disparate e difficilmente ognuno le cambierà. Quindi può essere interessante spostare il punto di vista, magari ampliandolo un po’.

La rivoluzione di Uber, e in generale di tutta la sharing economy, deriva dal progresso tecnologico, quindi dallo sviluppo delle tecnologie di comunicazioni, delle reti e della potenza di calcolo delle macchine. Questa evoluzione è la stessa che sta producendo ricerche avanzatissime sull’intelligenza artificiale, che proprio nell’automotive vede uno dei suoi principali campi di applicazione, come accade anche nelle nuove tecnologia di trasmissioni mobili: le reti a 5G. Nell’arco di un quinquennio si stima che i device connessi a reti a 5G saranno milioni e questo incoraggerà lo sviluppo di tecnologie per auto intelligenti, ossia capaci di guidarsi da sole che già da tempo attirano l’attenzione di giganti come Google, impegnato in un progetto auto “intelligente”. Proprio in questi giorni, peraltro, si è parlato del primo trattore senza guidatore, mentre nel trasporto su ferro i sistemi driveless sono ormai molto diffusi. Il problema dei tassisti, perciò, è lo stesso che nell’arco di qualche anno avranno in generale i conducenti di diversi veicoli, non solo taxi. E non dipende da Uber, ma dallo sviluppo tecnologico, di cui Uber è solo una declinazione circostanziale.

Una interessante simulazione, contenuta in uno studio sull’intelligenza artificiale diffuso nel dicembre scorso dalla Casa Bianca stima che una quota di posti di lavoro compresa fra i 2,2 e i 3,1 milioni nel settore dei trasporti potrà essere seriamente minacciato dallo sviluppo delle tecnologie di automazione dei veicoli (automated vehicles, AVs). Questa stime, come tutte quelle di questo genere, vanno prese con le pinze, poiché non considerano i posti di lavoro che le nuove tecnologie creeranno in sostituzione più o meno parziale di quelli distrutti, e che questi cambiamenti impiegheranno anni a verificarsi. E tuttavia sarebbe poco saggio sottovalutarli. Le tecnologie AVs, piaccia o no, sono il futuro.

Questa tabella riepiloga il loro impatto sui lavoratori Usa impegnati nel settore dei trasporti censiti dalle statistiche nel 2015. Come si può osservare si parla di un settore che impiega quasi quattro milioni di persone negli Usa, che si connotano per una paga oraria inferiore ai 20 dollari. In tal senso, lo sviluppo di queste tecnologie provoca esternalità che colpiscono innanzitutto i lavoratori con i redditi più bassi, i low skilled, come vengono definiti. Costoro, se è pur vero che godono, in quanto consumatori, dei vantaggi che lo sviluppo tecnologico sta portando sul versate dei costi di molti beni e servizi, sono comunque quelli maggiormente sotto pressione sul versante dei redditi e lo saranno ancor di più in futuro. Parliamo di milioni di persone. Sarebbe poco saggio ignorarle.